O Superior Tribunal de Justiça estabeleceu que a inteligência artificial não substitui a perícia oficial em processos criminais.

(Imagem: gerado por IA)

O Superior Tribunal de Justiça estabeleceu que a inteligência artificial não substitui a perícia oficial em processos criminais.

(Imagem: gerado por IA)

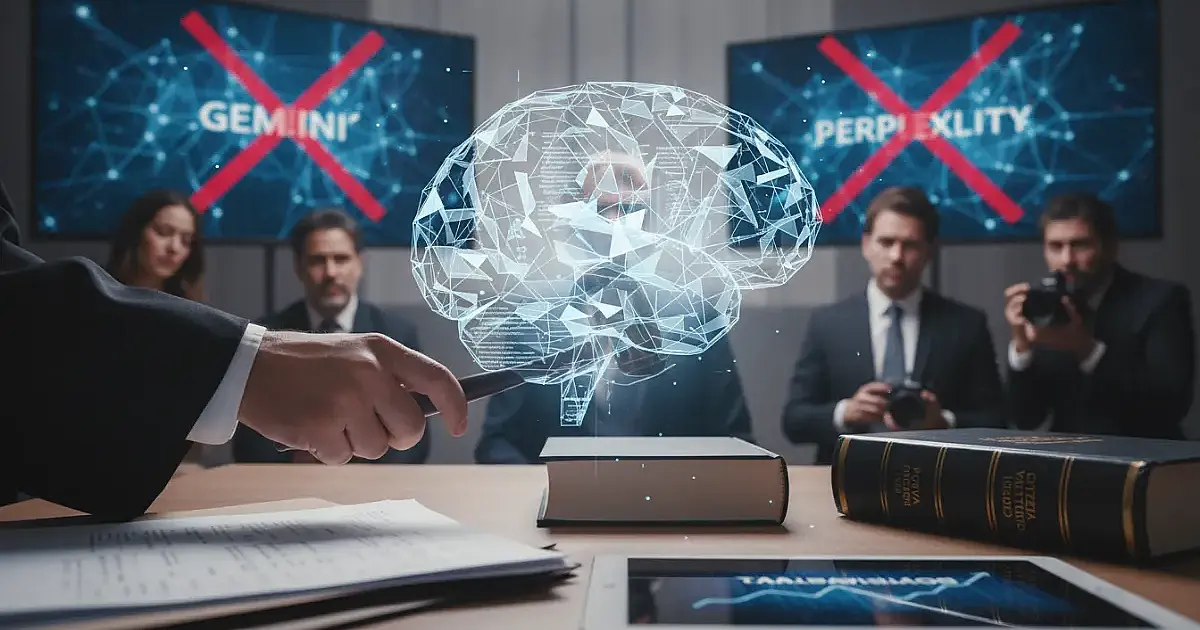

A Justiça brasileira acaba de impor um limite claro ao avanço desenfreado dos algoritmos nos tribunais: a inteligência artificial não pode ser usada como prova fundamental para sustentar uma acusação penal. Em uma decisão histórica, o Superior Tribunal de Justiça (STJ) rejeitou um relatório policial baseado nas ferramentas Gemini e Perplexity, estabelecendo um precedente que deve moldar o futuro do Direito e da investigação criminal no país.

O caso que motivou a decisão envolveu uma acusação de injúria racial contra o vice-prefeito de São José do Rio Preto, Fábio Marcondes. Enquanto a perícia oficial do Instituto de Criminalística não conseguiu confirmar a ofensa em um vídeo da discussão, após análise técnica de fonética e acústica, investigadores utilizaram ferramentas de IA para 'interpretar' o áudio. O relatório gerado pela tecnologia afirmou que a expressão ofensiva ocorreu, servindo de base para a denúncia do Ministério Público. Contudo, para o STJ, a probabilidade algorítmica não substitui a certeza jurídica.

Na prática, isso muda mais do que parece. Ao acolher o pedido da defesa, o ministro relator Reynaldo Soares da Fonseca tocou em uma ferida aberta da tecnologia moderna: a falta de confiabilidade absoluta das respostas geradas por máquinas que, embora sofisticadas, ainda operam em um campo de incerteza estatística. Mas o impacto vai além de um caso isolado de suposta injúria.

O risco das 'alucinações' digitais no banco dos réus

O ponto central que levou à rejeição da prova foi o fenômeno técnico conhecido como 'alucinação'. Segundo o ministro Fonseca, as IAs generativas podem apresentar informações imprecisas, irreais ou completamente fabricadas com uma aparência de total fidedignidade. Em um processo penal, onde a liberdade de um indivíduo está em jogo, aceitar um veredito baseado em padrões estatísticos seria um risco democrático inaceitável.

Os sistemas de IA operam buscando padrões em vastos bancos de dados, mas não possuem a capacidade de julgamento contextual ou a precisão científica exigida de um perito humano oficial. O STJ entendeu que essas ferramentas são auxiliares, mas jamais substitutas da perícia técnica tradicional, especialmente quando os resultados divergem dos laudos oficiais emitidos por órgãos de criminalística.

O que muda na prática jurídica daqui para frente

Com essa determinação, a Quinta Turma do STJ ordenou a exclusão imediata do relatório dos autos e exigiu que uma nova decisão sobre a admissibilidade da acusação seja tomada sem considerar os dados da IA. E é aqui que está o ponto central: a decisão protege o sistema contra o uso de ferramentas 'caixa-preta', cujos critérios de conclusão muitas vezes não são transparentes nem auditáveis pela defesa ou pelo magistrado.

Especialistas apontam que a decisão não proíbe o uso de tecnologia, mas exige que ela seja submetida ao crivo humano e ao rigor da cadeia de custódia. O futuro das investigações deve caminhar para uma integração mais ética, onde a máquina ajuda a processar dados, mas a palavra final sobre a verdade dos fatos permanece sob a responsabilidade de peritos e juízes, garantindo que o direito de defesa não seja atropelado por uma linha de código imprecisa.